大模型 (LLM) 中常用的 Normalization 有什么? - 知乎

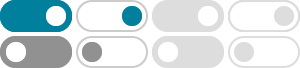

LayerNorm 其实目前主流的 Normalization 有个通用的公式 其中, 为均值, 为归一化的分母,比如对 LayerNorm 来说他是标准差,对 WeightNorm 来说是 L2 范数。 和 为可学习的参数,可以让模型根据 …

如何评价 Meta 新论文 Transformers without Normalization?

想法: 原文说的是without normalization,但是其实是换成了tanh,然后RMSNorm和hardtanh以及tanh的一种关系也有群友已经给出了,所以只是换了一种方式… 概括下来,就是不比normalization快,也 …

如何理解Normalization,Regularization 和 standardization?

May 16, 2017 · 如何理解Normalization,Regularization 和 standardization? 我知道的是:normalization和standardization是降低极端值对模型的影响. 前者是把数据全部转成从0-1;后者是 …

如何理解归一化(Normalization)对于神经网络(深度学习)的帮助? …

2016, Layer Normalization (没有发表) 用于RNN 2016, Instance Normalization (没有发表,但是经过了实践检验) 用于风格迁移 2016, Weight Normalization (NIPS) 2015, Batch …

CNN为什么要用BN, RNN为何要用layer Norm? - 知乎

Normalization 不管是 Batch Normalization 还是 Layer Normalization, Normalization的目的是为了把输入转化成均值为0方差为1的数据。 换句话说,这里的 Normalization 其实应称为 Standardization ( …

深度学习中 Batch Normalization为什么效果好? - 知乎

Normalization是一个统计学中的概念,我们可以叫它 归一化或者规范化,它并不是一个完全定义好的数学操作 (如加减乘除)。 它通过将数据进行偏移和尺度缩放调整,在数据预处理时是非常常见的操 …

标准化和归一化什么区别? - 知乎

缩放到0和1之间,保留原始数据的分布(Normalization—— Normalizer ()) 1就是常说的z-score归一化,2是min-max归一化。 举个例子来看看它们之间的区别,假设一个数据集包括「身高」和「体重」 …

z-score 标准化 (zero-mean normalization) - 知乎

最常见的标准化方法就是 Z标准化,也是 SPSS 中最为常用的标准化方法,spss默认的标准化方法就是z-score标准化。 也叫 标准差 标准化,这种方法给予原始数据的均值(mean)和标准差(standard …

l1正则与l2正则的特点是什么,各有什么优势? - 知乎

理解L1,L2 范数 L1,L2 范数即 L1-norm 和 L2-norm,自然,有L1、L2便也有L0、L3等等。因为在机器学习领域,L1 和 L2 范数应用比较多,比如作为正则项在回归中的使用 Lasso Regression (L1) 和 …

深度学习中 dropout 和 batch normlization 可以减少过拟合,原理是什 …

前导知识 LSTM 前言 Dropout是深度学习中被广泛的应用到解决模型过拟合问题的策略,相信你对Dropout的计算方式和工作原理已了如指掌。这篇文章将更深入的探讨Dropout背后的数学原理,通 …